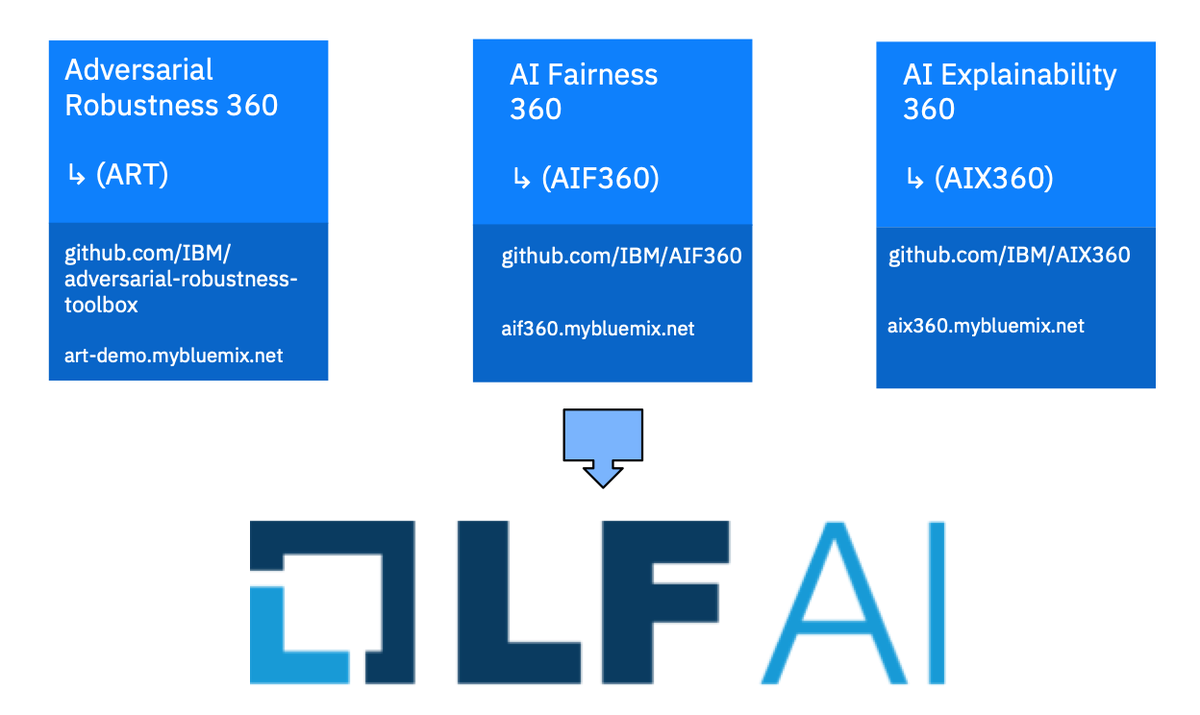

此次 IBM 一共贡献了三项工具,分别是 AI Fairness 360 Toolkit、Adversarial Robustness 360 Toolbox 和 AI Explainability 360 Toolkit:

- AI Fairness 360 工具包可帮助检测和减轻整个 AI 应用程序中机器学习模型的偏差;

- Adversarial Robustness 360 Toolbox (ART) 是一个 Python 库,旨在保证机器学习的安全性,使神经网络免受攻击;

- AI Explainability 360 工具包则提供了一套全面的算法,涵盖了解释的不同维度以及代理的可解释性指标,用以支持机器学习模型的可解释性。

该项目于本月初由 LFAI 技术咨询委员会投票通过,已正式移交基金会托管和孵化。

IBM 在去年加入 LFAI,随后协助建立了可信赖的 AI 委员会(Trusted AI Committee),该委员会致力于定义和实施 AI 部署中的可信赖原则。

“在构建可信赖和公平的 AI 时,技术只是等式的一部分”,IBM 表示,“社会科学、政策和立法以及各种观点的贡献与技术本身同样重要。”

除了贡献开源工具包外,IBM 也通过资助来鼓励负责任的技术部署行为。其开源社区的最近一笔捐款就拨给了哥伦比亚一个非营利组织,该组织正在帮助当地女性学习编码,并提供教育和职业发展支持。

消息来源:https://www.zdnet.com/article/ibm-donates-trusted-ai-projects-to-linux-foundation-ai/